Diffusion_Models Generative_Models 文献来源:

- [2209.00796] Diffusion Models: A Comprehensive Survey of Methods and Applications

- [2303.07909] Text-to-image Diffusion Models in Generative AI: A Survey

1. 基础扩散模型

目前的扩散模型主要分为三类:

- 去噪扩散概率模型(Denoising Diffusion Probabilistic Models, DDPMS)

- 基于分数的生成模型(score-based generative models, SGMs)

- **随机微分方程模型(stochastic differential equations, Score SDEs)

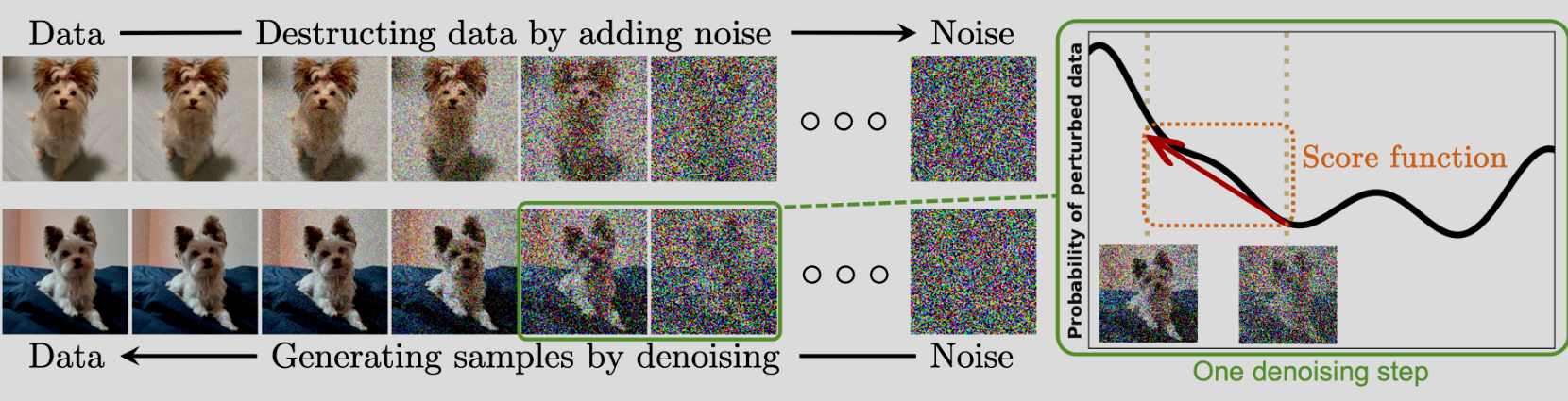

核心思想是统一的:通过逐步增强的随机噪声(称为”扩散”过程)扰动数据,再通过连续去噪来生成新数据样本

1.1 去噪扩散概率模型(DDPM)

核心思想是利用两条马尔可夫链:一条前向链将数据扰动为噪声,另一条逆向链将噪声转换回数据。前向链通常采用人工设计,旨在将任意数据分布转化为简单先验分布(如标准高斯分布),而后向马尔可夫链则通过学习深度神经网络参数化的转移核来逆转前向过程。

Note

马尔可夫链(Markov Chain)是一种随机过程,用于描述一个系统在不同状态之间以某种概率规则转移的过程。它的核心思想是:当前状态只与前一个状态有关,而与更早的历史无关

在生成新数据样本时,DDPM 首先从先验分布(通常易于获取)生成一个无结构的噪声向量,然后通过沿时间逆向运行可学习的马尔可夫链逐步消除其中的噪声。

1.2 基于分数的生成模型(SGM)

基于分数的生成模型的核心是得分函数。

Note

给定概率密度函数 ,其得分函数定义为对数概率密度的梯度 。

核心思想是通过一系列强度递增的高斯噪声扰动数据,并通过训练一个以噪声水平为条件的深度神经网络模型来联合估计所有噪声数据分布的分数函数。 训练目标为:

1.3 随机微分方程(Score SDE)

DDPM(去噪扩散概率模型)和 SGM(基于分数的生成模型)可以进一步推广到无限时间步长或噪声水平的情况,在这种情况下,扰动和去噪过程是随机微分方程(SDEs)的解。这个框架被称为 分数随机微分方程(Score SDEs),它利用 SDEs 进行噪声扰动和样本生成,而去噪过程需要估计噪声数据分布的概率密度梯度。 Score SDEs 通过扩散过程将数据扰动成噪声,其由以下随机微分方程(SDE)控制: 其中, 和 分别是扩散函数和漂移函数, 是标准维纳过程(布朗运动)。DDPM 和 SGM 中的前向过程都可以看作是这个 SDE 的离散化形式。

于任何形式如上述的扩散过程,都可以通过求解以下逆向时间 SDE 实现过程的逆转:

在每个训练步骤中,我们只需要:

- 随机采样一个真实数据 x₀。

- 随机采样一个时间步 t。

- 随机采样一个标准高斯噪声 ε。

- 计算带噪数据 xₜ = x₀ + σₜε。

- 将 xₜ 和 t 输入模型得到预测分数 s_θ(xₜ, t)。

- 计算损失,然后用更新模型参数

2. 文本到图像扩散模型

文本生成图像,根据扩散过程实施位置可大致分为两类:像素空间或潜空间。第一类方法直接从高维像素层面生成图像,包括 GLIDE和 Imagen;另一类研究则提出先将图像压缩至低维空间,再于该潜空间训练扩散模型,典型代表包括 Stable Diffusion 和 DALL-E 2 。

2.1 像素空间模型

- GLIDE (OpenAI):采用了无分类器引导 (Classifier-Free Guidance)。这是一种强大的技术,它不依赖于一个独立的分类器来“引导”生成,而是通过在训练时随机丢弃文本条件,让一个模型同时学会“有条件生成”和“无条件生成”,从而在推理时增强文本的引导力。

分类器

这里是指视觉模型,对生成图像与文本条件进行对比

- Imagen (Google):同样使用无分类器引导,但而是直接使用了预训练好的、参数冻结的大型语言模型

2.2 潜空间模型

- Stable Diffusion:Stable Diffusion结构

- DALL-E 2: 它工作在 CLIP 模型学习到的多模态联合潜空间中。在这个空间里,匹配的图像和文本的编码是相近的。编码器根据输入的文本编码生成一个对应的图像编码,解码器将图像编码解码成一张真实的图像。

3. 条件扩散发展方向

3.1 扩散模型中的条件控制机制

目前主要存在四种条件机制:拼接式、基于梯度、交叉注意力以及自适应层归一化(adaLN)。

- 拼接式机制指扩散模型在去噪过程中将条件信息(如标签嵌入向量和语义特征图)与中间去噪目标进行通道拼接。

- 基于梯度的机制通过将任务相关梯度融入扩散采样过程实现可控生成,例如在图像生成中可先训练噪声图像分类器,再利用梯度引导采样过程朝向指定类别标签。

- 交叉注意力机制通过层级化注意力层在条件信息与去噪目标之间建立消息传递通道,该机制通常在去噪网络中逐层实现。

- adaLN 机制遵循了自适应归一化层在生成对抗网络中的广泛应用探索了在基于 Transformer 的扩散模型主干中用自适应层归一化替代标准层归一化。

3.2 基于 DPO/RLHF 的扩散模型

扩散模型可以采用LLMs中的训练方法RLHF与DPO。部分方法采用预训练奖励模型或训练新模型来引导生成过程,另有方法绕过奖励模型训练,直接在人类偏好数据集上微调扩散模型,还有Diffusion-DPO重构了直接偏好优化(DPO)框架。

3.3 基于标签与分类器的条件扩散

目标是解决在少标签的情况下提升生成质量:

- 基于自生成层次标签集的自引导扩散过程

- 使用分类器引导